Діпфейки та аудіофейки: як росіяни підробляють голоси і чи складно розрізнити

В останні роки російські інформаційні операції отримали новий технологічний інструмент — підроблені голоси. Якщо про deepfake-відео вже чули багато, то аудіофейки — менш відомий, але не менш небезпечний спосіб маніпуляції.

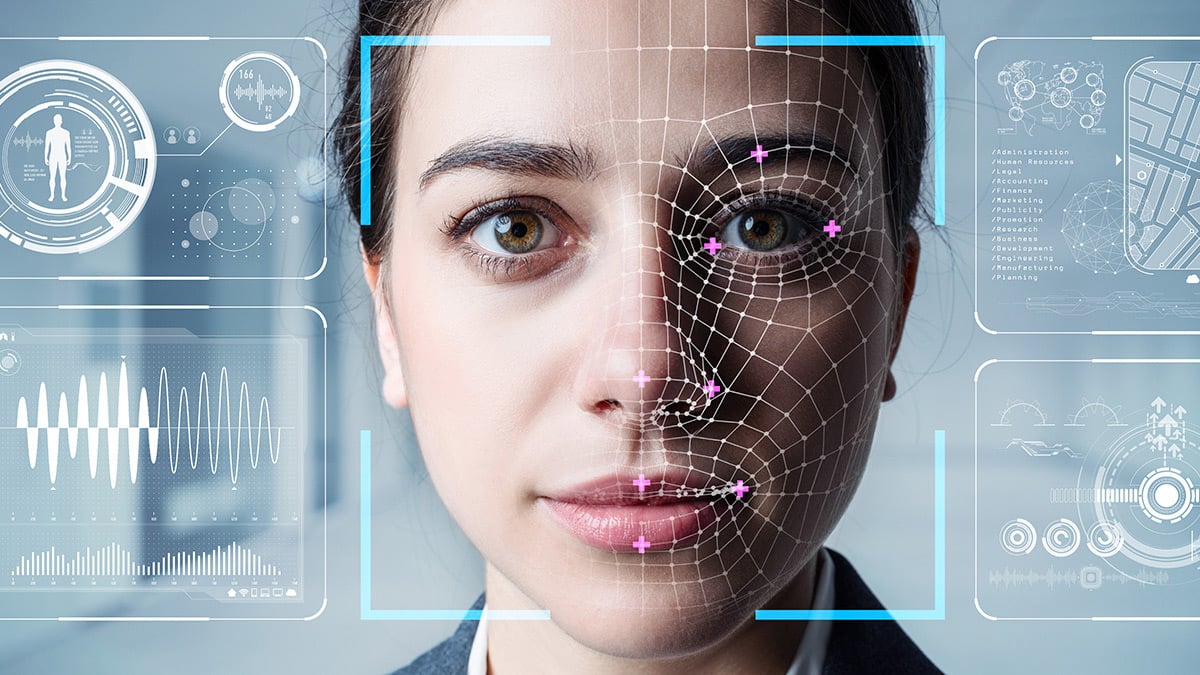

Суть проста: за допомогою штучного інтелекту створюється копія голосу реальної людини, яка вимовляє фрази, яких вона ніколи не казала. Технологія працює настільки точно, що пересічний слухач не здатен відрізнити справжнє повідомлення від згенерованого.

У цьому — головна загроза. Підроблений голос не потребує складного відеомонтажу, не викликає візуального сумніву, звучить переконливо і проникає в найуразливіші емоційні точки. Коли мати чує «сина з фронту», а військовий — «наказ командира», складно зберігати критичне мислення.

Нові інструменти ІПСО

Від початку 2024 року в Україні зафіксовано кілька хвиль інформаційних атак із використанням фейкових голосів. Телефоном або через месенджери розсилаються голосові повідомлення нібито від імені військових, родичів, представників влади чи навіть волонтерів.

Зміст — максимально емоційно заряджений: прохання про допомогу, новини про втрату, термінові накази або погрози. У деяких випадках такі повідомлення змушували людей діяти негайно: перераховувати кошти, залишати позиції, скасовувати заплановані дії.

Примітно, що ці фейки не обов’язково поширюються централізовано. Часто вони запускаються через чутливу аудиторію — наприклад, матерів військових або волонтерські кола, які довіряють голосовому контакту більше, ніж тексту. Усе, що потрібно для атаки, — короткий зразок голосу, який легко отримати з відео у соцмережах або публічних виступів.

Як це працює і чому це небезпечно

Технології синтезу мовлення зараз доступні будь-кому: існують десятки онлайн-сервісів, де можна завантажити зразок голосу і отримати аудіофайл зі штучною промовою. Якщо раніше такі можливості були лише в дослідницьких лабораторіях або спецслужб, то сьогодні це — комерційний продукт.

Небезпека в тому, що голос — це ключ довіри. Люди сприймають його як більш особисте джерело, ніж текст чи зображення. А тому голосова дезінформація проникає швидше і глибше. Її важко перевірити: запис можна легко змонтувати, номер телефону підробити, а емоційна реакція часто випереджає здоровий глузд.

Як розпізнати аудіофейк і що робити

Поки що немає простого інструменту для миттєвої перевірки таких фейків. Але є кілька речей, які можуть насторожити. Якщо голос звучить трохи неприродно, мовлення ритмічно одноманітне, інтонації ніби пласкі або занадто ідеальні — це може бути ознакою синтезу. Варто насторожитися, якщо ви отримали неочікуване голосове повідомлення від знайомого, з яким не спілкувалися давно, особливо — з проханням щось зробити терміново.

У випадку підозри — звʼяжіться з людиною напряму, через перевірений канал. Уточніть інформацію, не поспішайте діяти. Якщо фейк поширився в групі чи спільноті — важливо попередити інших, надати контекст, зменшити емоційну реакцію.

Російські інформаційні операції не стоять на місці. Зі зростанням технологій змінюється й арсенал засобів впливу. Аудіофейки — один із найнебезпечніших напрямів, бо в них складно засумніватися. Тому найважливіше сьогодні — зберігати обачність, не довіряти сліпо навіть «знайомому» голосу, перевіряти інформацію з кількох джерел і вчити цьому інших. У світі, де фейк навчився говорити твоїм голосом, критичне мислення — єдиний захист.